-

qq_慕函数6335445

qq_慕函数6335445

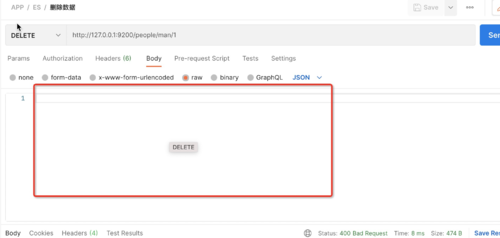

- 删除数据索引报错

把请求体删掉

把请求体删掉- 2021-04-05 1回答·745浏览

-

qq_慕函数6335445

qq_慕函数6335445

- 删除数据/索引报错

报错信息贴下。可能是请求body有误或无对应索引。

- 2021-04-05 1回答·749浏览

-

慕丝Jack

慕丝Jack

- 瓦力老师,能不能把数据发一下

批量插入数据

PUT http://localhost:9200/book/novel/_bulk

{ "index":{"_id": "5"} }

{ "author": "王五", "title": "菜谱", "word_count": 5000, "publish_date": "2002-10-01"}

{ "index":{"_id": "8"} }

{ "author": "瓦力", "title": "ElasticSearch入门", "word_count": 3000, "publish_date": "2017-08-20"}

{ "index":{"_id": "9"} }

{ "author": "很胖的瓦力", "title": "ElasticSearch精通", "word_count": 3000, "publish_date": "2017-08-15"}

{ "index":{"_id": "10"} }

{ "author": "牛魔王", "title": "芭蕉扇", "word_count": 1000, "publish_date": "2000-10-01"}

{ "index":{"_id": "2"} }

{ "author": "李三", "title": "Java入门", "word_count": 2000, "publish_date": "2010-10-01"}

{ "index":{"_id": "4"} }

{ "author": "李四", "title": "ElasticSearch大法好", "word_count": 1000, "publish_date": "2017-08-01"}

{ "index":{"_id": "6"} }

{ "author": "赵六", "title": "剑谱", "word_count": 10000, "publish_date": "1997-01-01"}

{ "index":{"_id": "1"} }

{ "author": "张三", "title": "移魂大法", "word_count": 1000, "publish_date": "2000-10-01"}

{ "index":{"_id": "7"} }

{ "author": "张三丰", "title": "太极拳", "word_count": 1000, "publish_date": "1997-01-01"}

{ "index":{"_id": "3"} }

{ "author": "张四", "title": "Python入门", "word_count": 2000, "publish_date": "2005-10-01"}

{ "index":{"_id": "11"} }

{ "author": "孙悟空", "title": "七十二变", "word_count": 1000, "publish_date": "2000-10-01"}

{ "index":{"_id": "11"} }

{ "author": "瓦力", "title": "瓦力教我们学ElasticSearch", "word_count": 1000, "publish_date": "2017-08-01 00:00:00"}

- 2020-12-10 1回答·765浏览

-

幕布斯6497522

幕布斯6497522

- boolean数据处理后到es报错

同样求助

- 2020-06-29 1回答·885浏览

-

慕后端6576068

慕后端6576068

- 集群分片查询

分片不影响查询的,也就是集群和单机的查询语法是一样的,查询结果不受影响

- 2019-12-30 1回答·1133浏览

-

金色年华ch

金色年华ch

- 查询全部数据返回的took是啥意思?为啥postman给出的响应时间和took不一致

- 2019-12-18 2回答·2263浏览

-

慕桂英5157884

慕桂英5157884

- elasticsearch集群

- 2019-07-23 2回答·992浏览

-

梦幻逍遥IT

梦幻逍遥IT

- 老师, 您好, 一个索引下可以有多个类型吧,这时 条件查询和聚合查询怎么写?

好好学习多多思考

- 2019-06-28 1回答·972浏览

-

梦幻逍遥IT

梦幻逍遥IT

- 老师, 您好, elasticsearch有一个优势: 海量数据分析, 大数据量快速搜索; 体现在哪?

最简单直观的方法 就是在往数据库添加数据时也往ES里填一份 相应的删除、改动时也同步进行 查询时就查ES就好了

- 2019-06-26 1回答·1529浏览

-

梦幻逍遥IT

梦幻逍遥IT

- 老师, 您好, 聚合查询时用到了关键字term是什么意思, 其他还有哪些关键字? 比如: max,min,count,sum,avg?

term是代表完全匹配,也就是精确查询,搜索前不会再对搜索词进行分词

- 2019-06-26 1回答·1112浏览

-

sunnyday1993

sunnyday1993

- 请问录制视频用的是什么软件

Mac自带QuickTime Player

- 2019-06-05 1回答·818浏览

-

慕粉3480043

慕粉3480043

-

慕码人1464173

慕码人1464173

- 怎么对text、keyword等数据类型进行聚合查询

兄嘚 这种情况要看具体问题了 问问题 报了什么错 要贴出来啊 老师演示没问题 基本就是你的问题了

- 2019-02-26 1回答·1238浏览

-

qq_慕前端011593

qq_慕前端011593

- 我想问下es的中文分词ik有什么作用?怎么使用?

- 2019-01-14 2回答·2930浏览

-

qq_原点_25

qq_原点_25

- 排序时报错

应该是分词问题

- 2018-12-15 2回答·1003浏览

-

qq_原点_25

qq_原点_25

- 为什么我的关键词查询没有结果呢?如果输入完整的话才会有结果

是不是可以用match_phrase_prefix查啊

- 2018-12-15 4回答·1462浏览

-

西瓜滚雪

西瓜滚雪

- 数据插入方法

最后一行需要回车换行

- 2018-09-02 3回答·856浏览

-

snow_leopard

snow_leopard

- 我用的6.3.1的es,我发现它怎么没查出来,换成get方式查出来了,但是没有排序

我也刚学,有问题这里问吧!让更多的人来回答

- 2018-08-07 2回答·1313浏览

-

慕粉1442009425

慕粉1442009425

- 为什么我的不是模糊匹配

用get就好了。。。

- 2018-06-30 2回答·1190浏览

-

qq_以夢為馬_1

qq_以夢為馬_1

- 我这里为什么会查出四条

- 已采纳 weibo_扪烛天难_03547939 的回答

因为match是模糊匹配查询,查询的时候不是整词匹配的 而是匹配“三”“国”“演”“义”这四个字分开匹配,之前几本书都叫三国演义,相当于全匹配了,演员的自我修养刚好有演字,所以也匹配上了,如果有图书名带三国演义中的任意一个或几个字也是都可以匹配出来的,看下一节老师讲的内容 就能明白了

- 2018-05-02 2回答·1428浏览

-

weibo_旮旯爿片_0

weibo_旮旯爿片_0

- mapping相关

用来设置存储的信息,比如淘宝的商品,数据库中有很多字段,商品名,价格,归属地,图片,归属商家,详情图片,套餐详情等等,但是查询的时候不需要那么多,一般只需要显示一个图片,名称,价格,商家,销量 mapping就是用来设置需要显示的这些字段

我也刚看这个,如果是solr的话会对每个字段有自己的设置,是否分词,是否索引,是否存储

- 2018-02-25 1回答·1036浏览

-

我真的知道

我真的知道

- "from":1中的1是指哪里?

- 已采纳 慕函数5571842 的回答

from 表示的是分页 0表示第一页,一次类推,size是页码,表示每页查询多少条数据

- 2018-02-23 3回答·1591浏览