-

- 嘀嗒啦 2020-10-20

两种目标函数的公式。

多分类时常用交叉熵损失

-

截图0赞 · 0采集

-

- 嘀嗒啦 2020-10-20

目标函数(损失函数)定义:衡量对数据的拟合程度

one-hot编码:https://www.cnblogs.com/shuaishuaidefeizhu/p/11269257.html

-

截图0赞 · 0采集

-

- 嘀嗒啦 2020-10-20

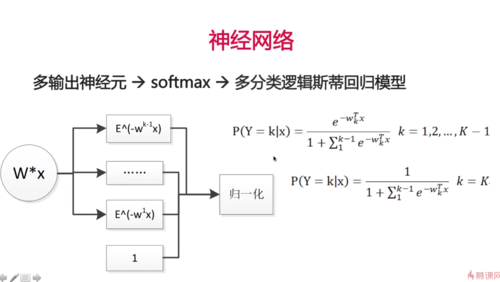

多神经元可以实现多输出的神经网络模型

多分类问题比二分类问题有更广的适用性

公式:

-

截图0赞 · 0采集

-

- 烟斗丝丶 2019-09-10

多分类逻辑斯蒂回归模型

-

截图0赞 · 0采集

-

- MariaBrown 2019-08-21

1. 多分类逻辑斯底回归模型:——多个神经元

一个神经元需要一个W,两个神经元需要两个W,所以由向量扩展成矩阵。

2. 多分类问题比二分类问题具有更广泛的适用性。

3. 多分类和二分类的逻辑斯蒂回归模型也可以被认为是神经网络。

4. 如何调整神经网络可以使神经网络学到数据中的规律?

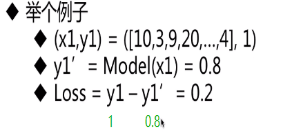

目标函数:衡量对数据的拟合程度,在机器学习领域中通常也被称为损失函数。举例:

(1)平方差损失

(2)交叉熵损失

神经网络训练:调整参数使模型在训练集上的损失函数最小。

- 0赞 · 0采集

-

- qq_蠢到深处自然萌_rtyZ58 2019-08-20

单个神经元->sigmod(激活函数)->二分类逻辑斯蒂回归模型

多输出神经元->softmax->多分类逻辑斯蒂回归模型

目标函数:衡量对数据的拟合程度(损失)

神经网络训练目的:调整参数,使模型在训练集上的损失函数最小

- 0赞 · 0采集

-

- 寂寞微笑 2019-01-16

各类损失函数

-

截图0赞 · 0采集

-

- 寂寞微笑 2019-01-16

目标函数/

-

截图0赞 · 0采集

-

- 寂寞微笑 2019-01-16

多输出神经元例子

-

截图0赞 · 0采集

-

- 寂寞微笑 2019-01-16

归一化,多输出神经元

-

截图0赞 · 0采集

-

- 寂寞微笑 2019-01-16

多个神经元

-

截图0赞 · 1采集

-

- Ian_Morris 2019-01-03

平方差损失vs交叉熵损失

-

截图0赞 · 0采集

-

- 凡简 2018-12-04

神经网络训练

-

截图0赞 · 0采集

-

- 凡简 2018-12-04

神经网络--目标函数

-

截图0赞 · 0采集

-

- 凡简 2018-12-04

W*x多输出神经元

-

截图0赞 · 0采集

-

- 凡简 2018-12-04

多输出神经元

多分类

-

截图0赞 · 0采集

-

- 凡简 2018-12-04

神经元--多输出

-

截图0赞 · 0采集

-

- GoingForward 2018-11-30

多分类函数损失:平方差和交叉熵

-

截图0赞 · 0采集

-

- GoingForward 2018-11-30

多元分类,0.4大于其他概率,所以为第三类。损失函数定义为与目标分类的向量绝对值之和。

-

截图0赞 · 0采集

-

- GoingForward 2018-11-30

目标函数举例1:

二元分类,得到的分类为1的概念处于0到1之间,损失=1-预测为1的概率

-

截图0赞 · 0采集

-

- GoingForward 2018-11-30

多分类逻辑斯蒂回归模型思想(归一化)

-

截图0赞 · 0采集

-

- R6S猿 2018-11-25

每个输出都和矩阵每个向量做内积

-

截图0赞 · 0采集

-

- R6S猿 2018-11-25

神经元多输出例子

-

截图0赞 · 1采集

-

- R6S猿 2018-11-25

对分类逻辑回归模型=多加神经元

- 0赞 · 0采集

-

- 慕沐121585 2018-11-20

- 非常清晰明了,特别适合对机器学习有一定了解和应用,进一步学习深度学习的同学

-

截图0赞 · 0采集

数据加载中...