-

慕码人1353771

慕码人1353771

- 本课程的课件问题

- 2024-09-24 0回答·269浏览

-

整编者74师

整编者74师

- 懂js有web前端基础可以学吗?请先生明以教寡人,不以销售为目的。

- 2024-06-12 0回答·259浏览

-

整编者74师

整编者74师

- 有web前端编程经验没有数学基础,可学否?请先生明以教寡人而非以销售为目的。

可以学啊,数据基础不需要多多,多深,高中知识就差不多了吧。能理解。

- 2024-06-12 1回答·258浏览

-

BryantJames

BryantJames

- 矩阵和向量相乘结果还是向量吗

不是向量,是 3 * 3 的矩阵。

import numpy as np x = [[1], [1], [1]] y = [[1, 1, 1]] z = np.dot(x, y) print(z) print(z.shape) """ [[1 1 1] [1 1 1] [1 1 1]] (3, 3) """

- 2024-03-26 1回答·377浏览

-

qq_watermelon_14327755

qq_watermelon_14327755

-

慕斯卡6411321

慕斯卡6411321

- jumpy中的任务部分 是怎么打上去的

markdown

- 2023-12-03 1回答·365浏览

-

幕布斯0474723

幕布斯0474723

- 为什么没有矩阵的除法

矩阵不能直接相除。

B / A ,可以使用 B * A的逆矩阵,来实现相除, 但不是所有的矩阵都有逆矩阵。

A = nd.array([[1, 2], [6, 5]])

C = nd.linalg.inv(A) # C 为 A的逆矩阵

E = np.dot(B, C) # B * C 即 B / A

- 2023-10-17 1回答·457浏览

-

weixin_慕仔4426869

weixin_慕仔4426869

- p(A|B)和p(B)*p(A)有啥区别,这里有点混淆,望解答。

前者是当B发生了之后再发生A的概率。后者是B和A都发生的概率。

区别是前者中B已经发生确定了,此时计算A将要发生的概率。

后者是A和B都没发生,但是要预测他们都发生的概率

- 2023-02-25 1回答·414浏览

-

qq_慕雪8243059

qq_慕雪8243059

- 微积分的作用

我个人理解应该还不完全是这样,是本课程为了讲机器学习要借助数学中的矩阵和微积分工具,如矩阵和向量可以很好地进行多行数据的组织,微分可以采用导数概念很好地说明梯度下降法,而积分方法正好可以用来求解概率密度函数。

- 2022-09-29 1回答·460浏览

-

qq_慕雪8243059

qq_慕雪8243059

- 如何根据数据确定模型

- 2022-09-29 0回答·348浏览

-

weixin_慕尼黑7100639

weixin_慕尼黑7100639

- from sklearn.naive_bayes import CategoricalNB报错

- 2022-05-20 0回答·719浏览

-

MOCKINGT

MOCKINGT

- 课后答案?

A=[a11 a12 a13 a14

a21 a22 a23 a24

a31 a32 a33 a34

a41 a42 a43 a44]

- 2022-02-13 1回答·535浏览

-

慕婉清6579309

慕婉清6579309

- 线性函数y是否必须为连续变量?

- 2022-02-01 0回答·740浏览

-

李某人方文

李某人方文

- 代码能运行,结果和老师的也是一样,但是程序有个warning

#测试样本 #x_test=np.array([[0,0,0,1,1,0]]) x_test = pd.DataFrame([[0,0,0,1,1,0]], columns=list(['gender','age','status','city','cost','device'])) print(x_test) #x_feature_name=np.array(['gender','age','status','city','cost','device']) #print(x_test) y_test_pred_prob=model.predict(x_test) print(y_test_pred_prob) 测试数据类型的问题 x_test=np.array([[0,0,0,1,1,0]]) 是numpy里的ndarry类型;只有数据 要用pandas中DataFrame类型,这种类型里面包含feature_name,不会有warning.

- 2021-12-01 1回答·4927浏览

-

李某人方文

李某人方文

- 关于思考题的问题

A50人B60人C45人共155人

直接计算 (20+30+20)/ 155= 70/155 = 14/31

全概率:50/155*20/50+60/155*30/60+45/155*20/45 = 14/31

- 2021-11-30 1回答·755浏览

-

qq_慕斯8419600

qq_慕斯8419600

- 视频配套的学习材料有吗

- 2021-11-26 1回答·812浏览

-

慕粉4372717

慕粉4372717

- 公式中的y=x入+b的b指的是什么啊

一个常数

- 2021-06-22 1回答·1069浏览

-

慕UI4269038

慕UI4269038

- python应用到企业的数据分析案例有哪些?

- 2021-04-25 1回答·1031浏览

-

奋斗的蚁族

奋斗的蚁族

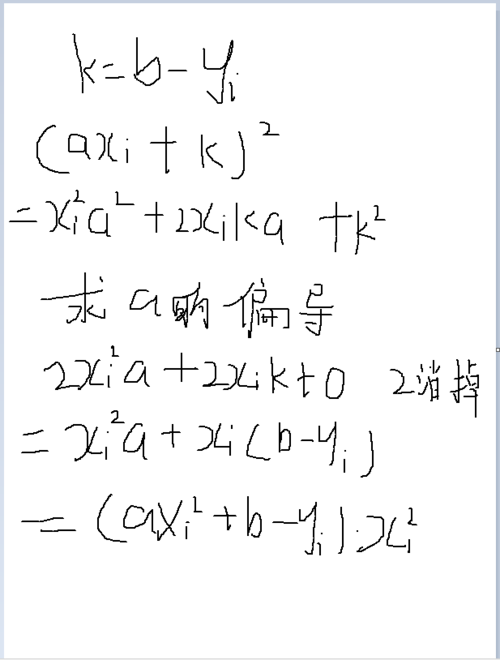

- tempa 推导出的公式最后为啥会有一个Xi,而tempb就没有呢?

请评论就给出正确答案,不要废话,不给答案评论别人只会显得你很愚蠢

这涉及到多元函数的求导 当为一元函数 如y=kx 它求导叫做导数

而多元函数 如 z=kx+by 求导时只能求一个变量的导数,比如我们求x的导数,这时就需要把y当作常量 此时称为函数对于x的偏导数,y同理。

所以你可以得到 x的偏导数为 z撇=k

所以题目中(axi+b-yi)的平方对a的偏导数求法为

设b-yi=k 则 原函数变为(axi+k)的平方 注意 此时 a是变量 xi为常量

则 开方变为 xi的平方*a的平方+2xika+k的平方

开始求导 则为 2*xi的平方*a+2xik +0

k带入 则为 2*xi的平方 *a +2xi(b-yi)

把2和前面的2m中的2消除 再提出xi

则为 xi*(axi+b-yi) 和视频相同

对于b的偏导数 各位可以参照方法自行求解

- 2021-04-11 2回答·1096浏览

-

奋斗的蚁族

奋斗的蚁族

- 第9分钟这里看了三遍没看懂

不是。θ1、θ2、θ3等都是矩阵。X可以理解为[x1,x2,...,xn]。a1,a2、a3都是单个数值,不是矩阵。

- 2021-04-08 1回答·940浏览

-

qq_慕莱坞5214717

qq_慕莱坞5214717

- 引入朴素贝叶斯模块时出现报错,怎么办?

numpy 这个版本和 sklearn 不匹配

- 2021-02-28 1回答·950浏览

-

慕哥8332276

慕哥8332276

- 矩阵A和向量D的乘积问题

- 已采纳 手机打不开 的回答

他输入的D是[[1],[2],[3]],不是2,3,4

- 2021-02-26 4回答·935浏览

-

qq_慕莱坞5214717

qq_慕莱坞5214717

- ImportError: cannot import name 'CategoricalNB',不知道怎么解决。

naive_bayes

- 2021-02-25 2回答·1027浏览

-

慕粉3132442

慕粉3132442

- 特征不独立,就不能用贝叶斯公式吗?

特征不独立,很容易统计到为0的情况,不适用贝叶斯公式

- 2021-01-23 3回答·947浏览

-

NeilSK

NeilSK

- 请教朴素贝叶斯答案

是的,在y=0的情况下,x2没有出现为0的情况,所以概率为0

- 2020-12-12 2回答·859浏览

-

NeilSK

NeilSK

- 请教老师问题

x --> 无穷大 其倒数或其平方的倒数都趋近0

- 2020-12-10 2回答·700浏览

-

KingCoder

KingCoder

- y=0的时候结果是0么?

是的,P(x2|yi) = 0, 分子为0,结果即为0

样本数太少,无法覆盖所有情况啊

- 2020-12-02 2回答·920浏览

-

慕姐7583206

慕姐7583206

- python软件

jupyter notebook

这个自己网上搜一下就有很多使用说明- 2020-08-09 2回答·768浏览

-

慕工程4448765

慕工程4448765

- 关于导数的讨论

可能是极值点,但也不一定,也有可能是拐点

- 2020-08-01 1回答·693浏览

-

weixin_慕慕3102166

weixin_慕慕3102166

- 手机登陆好了

? 刷机的吧??

- 2020-07-24 1回答·617浏览