-

- 码农届的大师大师届的菜鸟 2022-10-28

2022-10-28

- 0赞 · 0采集

-

- 1561147120 2020-08-28

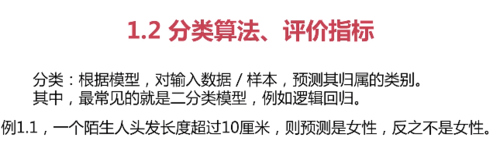

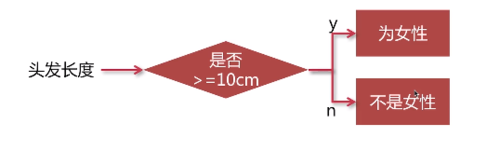

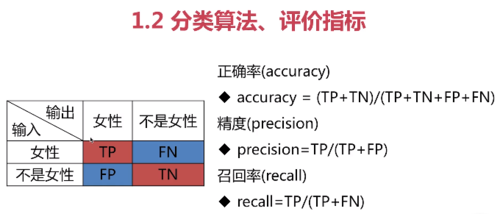

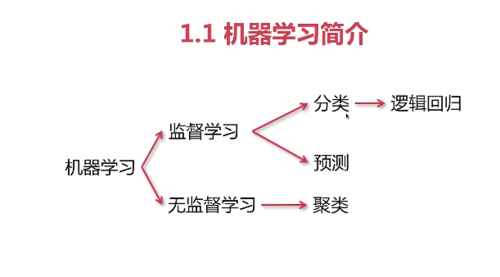

分类算法

分类学习的基本概念

建立模型逻辑:

类别并非男和女,而是女和非女,因为不清楚分类总和是否全体,所以采用A和非A作为分类。

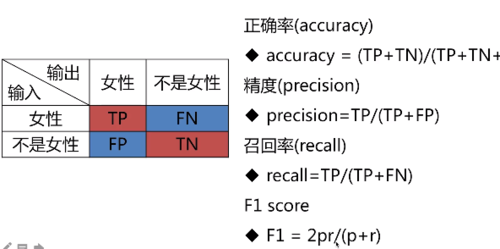

评价指标

正确率,代表在整体中识别正确的几率

精度:数据输出的正确率

召回率:输入的数据能够识别出来的正确率

F1 score 是精度和召回率的调和平均值

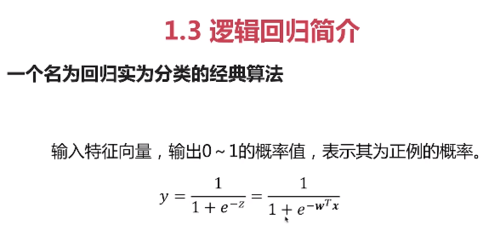

逻辑回归 :logistic回归(LR) 逻辑回归是一种广义的线性回归分析模型

常用于数据挖掘、疾病自动诊断、经济预测等等领域。

逻辑回归算法的优缺点

优点:思路清晰简单易实现,实现代价低

缺点:只能处理线性问题,对于非线性问题的拟合度、精度低

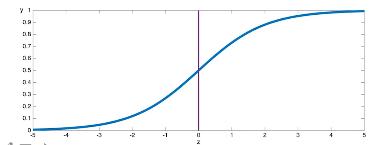

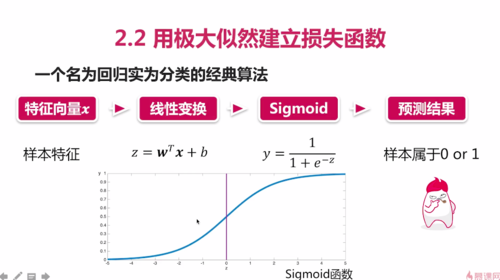

上图为sigmoid函数

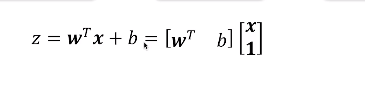

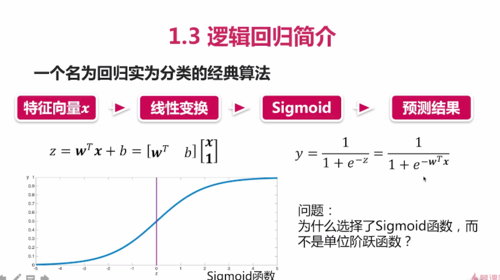

一般来说,在二维空间的线性变换下,z = ax + b ,同理 w^T在此也是系数矩阵,系数矩阵乘以特征向量加上常量,常量b可以加到w^T矩阵里面,省略不写b

sigmoid函数的图像:

逻辑回归的模型就是每个特征的回归系数,即W^T

特征:线性分类,不进行特别处理,无法处理非线性的问题

通过训练数据集,计算出最合适的系数向量,即W^T,最合适即是指错误概率最低的情况

应用:逻辑回归是分类算法的经典算法

- 0赞 · 0采集

-

- 1561147120 2020-08-28

逻辑回归,是监督学习里面的分类所使用的最经典算法

监督学习 使模型对给定的输入,能够映射预测的结果,使用有标记的数据。

非监督学习 直接对没标记的训练数据进行建模学习,使用无标记的数据。

- 0赞 · 0采集

-

- 慕函数8151796 2020-04-29

- 逻辑回归

-

截图0赞 · 0采集

-

- 慕数据8458121 2020-02-19

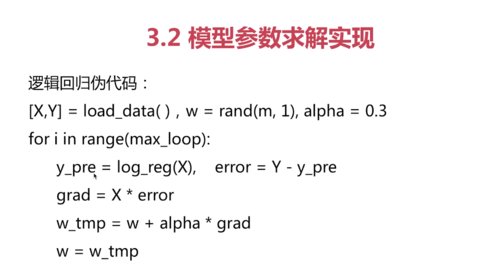

初始化回归系数向量

-

截图0赞 · 0采集

-

- 慕数据8458121 2020-02-19

测试章节下多个笔记

-

截图0赞 · 0采集

-

- 慕数据8458121 2020-02-18

本次学习位置0:31

- 0赞 · 0采集

-

- 不是学僧 2019-10-18

逻辑回归与线性回归之间的联系

-

截图0赞 · 0采集

-

- 不是学僧 2019-10-17

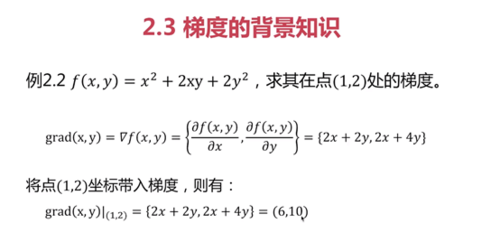

求梯度表达式

-

截图0赞 · 0采集

-

- 不是学僧 2019-10-17

样本属于真实标签的概率表达式

-

截图0赞 · 0采集

-

- 不是学僧 2019-10-17

似然函数表达式

-

截图0赞 · 0采集

-

- 不是学僧 2019-10-17

Maximum likelihood:

利用已知的样本结果,反推最有可能导致这样结果的参数值

- 0赞 · 0采集

-

- 不是学僧 2019-10-17

“最合适”,可理解为错误概率最低的情况

- 0赞 · 0采集

-

- 不是学僧 2019-10-17

逻辑回归的性质:线性分类器,若无特殊处理,无法解决非线性问题;

建模过程:通过训练数据集,计算出“最合适”的系数向量

- 0赞 · 0采集

-

- 不是学僧 2019-10-17

逻辑回归模型,就是每个特征的回归系数,即wT + b

- 0赞 · 0采集

-

- 不是学僧 2019-10-17

逻辑回归表达式;Sigmoid

-

截图0赞 · 0采集

-

- 不是学僧 2019-10-17

混淆矩阵;评价指标

-

截图0赞 · 0采集

-

- 刹那F塞尔 2019-08-15

梯度的计算方法

- 0赞 · 0采集

-

- beanho 2019-08-06

一个名为回归实为分类的经典算法

-

截图0赞 · 0采集

-

- beanho 2019-08-06

逻辑回归简介

-

截图1赞 · 0采集

-

- 慕粉4032101 2019-04-27

伪代码如图

- 0赞 · 0采集

-

- 慕田教授 2019-04-18

accuracy 实际意义不大

- 0赞 · 0采集

-

- 慕田教授 2019-04-18

正确率和精度不同

- 0赞 · 0采集

-

- 生化面包0 2019-03-16

- 借记卡

- 0赞 · 0采集

-

- 慕雪1102565 2019-03-15

- 混淆器

-

截图0赞 · 0采集

-

- 慕容8367992 2019-02-28

1111

111

- 0赞 · 0采集

-

- 慕数据8458121 2019-02-18

这个公式还需要好好分析一下

-

截图0赞 · 0采集

-

- sphy 2019-02-10

逻辑回归公式, 最后做的是l(w)关于w的梯度函数按w=w+α▽循环一定次数,关注w的值。不管梯度函数最后的值,也不管似然函数l(w)的值

-

截图0赞 · 0采集

-

- heaheahea 2019-01-29

得到某个参数值使似然函数结果最大

-

截图0赞 · 0采集

-

- heaheahea 2019-01-29

Maximum likelihood:

利用已知的样本结果,反推最有可能导致这样结果的参数值

-

截图0赞 · 0采集